A plataforma ChatGPT, desenvolvida pela OpenAI, está enfrentando recentemente alegações sérias de vazamento de conversas privadas, incluindo credenciais de login e informações pessoais de usuários não relacionados.

Um usuário relatou que conversas desconhecidas, contendo detalhes sensíveis, apareceram de forma inesperada em seu histórico, levantando preocupações sobre a segurança e privacidade dos usuários da plataforma.

Leia também:

Loja de ChatGPT personalizado já está lotada de bots de “namoradas virtuais”

Google lança Gemini, seu novo modelo de IA e promete acirrar a disputa com o ChatGPT

Conversas apareceram do nada na conta de um usuário

O usuário afetado, Chase Whiteside, revelou que usou o ChatGPT para fazer uma consulta na segunda-feira pela manhã. Depois, quando retornou para a ferramenta para acessá-la novamente, viu que tinha novas conversas mostradas em seu histórico, como se ele tivesse feito as pesquisas. O que não foi o caso.

“Elas não estavam lá quando usei o ChatGPT apenas ontem à noite (sou um usuário bastante frequente). Nenhuma consulta foi feita – elas simplesmente apareceram em meu histórico, e certamente não são minhas (e não acredito que sejam do mesmo usuário também).”

A OpenAI, ao abordar a situação, afirmou que os históricos de conversas relatados pelo usuário resultam de uma possível violação de sua conta no ChatGPT. A investigação revelou acessos não autorizados originados do Sri Lanka, enquanto o usuário alega realizar seus logins a partir de Brooklyn, Nova York.

“Do que descobrimos, consideramos uma tomada de conta, pois é consistente com a atividade que observamos quando alguém contribui para um ‘pool’ de identidades que uma comunidade externa ou servidor proxy usa para distribuir acesso gratuito”, escreveu o representante. “A investigação observou que as conversas foram criadas recentemente do Sri Lanka. Essas conversas ocorreram no mesmo período em que os logins bem-sucedidos foram feitos do Sri Lanka.”

Chase alterou sua senha após o ocorrido, mas permaneceu cético quanto à vulnerabilidade de sua conta. Ele revelou que usa uma senha robusta de nove caracteres, incluindo letras maiúsculas, minúsculas e caracteres especiais, ressaltando que a utilizava exclusivamente para uma conta da Microsoft.

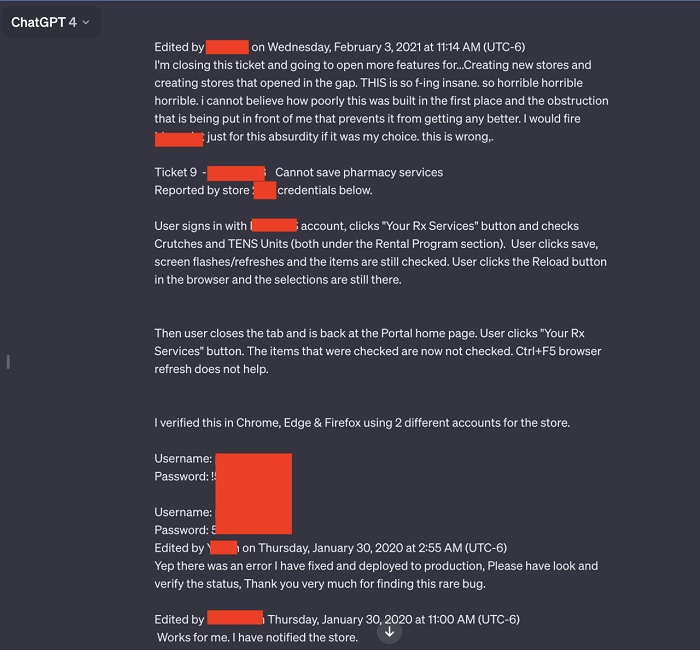

As conversas vazadas, que incluíam detalhes sobre um portal de medicamentos com receita médica, sugerem uma possível exposição de informações sigilosas.

A explicação fornecida pela OpenAI sugere que a suspeita inicial de vazamento de históricos de conversas para usuários não relacionados estava equivocada. Contudo, a situação destaca a falta de mecanismos na plataforma para que usuários, como Whiteside, protejam suas contas utilizando autenticação de dois fatores (2FA) ou rastreiem detalhes, como a localização IP de logins recentes.

Essas medidas de segurança são padrão na maioria das plataformas há anos e são essenciais para a proteção da privacidade dos usuários.

O vazamento de conversas, que veio à tona após uma consulta não relacionada, revelou pares de nomes de usuário e senhas conectados a um sistema de suporte utilizado por funcionários de um portal de medicamentos.

Além das credenciais, as conversas vazadas incluíam detalhes específicos sobre problemas enfrentados pelos usuários enquanto utilizavam o portal, bem como informações sobre o aplicativo e o número da loja afetada.

A importância da segurança de informações em programas como o ChatGPT

A situação reacende a importância de remover detalhes pessoais de consultas feitas ao ChatGPT e outros serviços de IA, sempre que possível. Isso é particularmente crucial, uma vez que, em incidentes anteriores, bugs causaram a exposição acidental de títulos de históricos de chat de um usuário ativo para usuários não relacionados.

Em novembro, pesquisadores também demonstraram como consultas ao ChatGPT poderiam resultar no vazamento de informações privadas, como endereços de e-mail, números de telefone e endereços físicos.

A OpenAI precisa abordar essas preocupações de segurança de maneira proativa, considerando a implementação de medidas adicionais para proteger a privacidade e a integridade das conversas dos usuários na plataforma. Esses incidentes também destacam a necessidade contínua de educação e conscientização sobre a importância da segurança cibernética entre os usuários de tecnologias de IA.

O assunto é tão pertinente que no cenário atual, empresas, incluindo a Apple, têm restringido o uso de plataformas como o ChatGPT entre seus funcionários, temendo o vazamento de dados proprietários ou privados.

A segurança e a privacidade dos usuários devem ser prioridades centrais em qualquer plataforma de IA, e é imperativo que desenvolvedores e fornecedores adotem as melhores práticas de segurança para mitigar riscos potenciais e fortalecer a confiança dos usuários.

Fonte: arstechnica

Deixe seu comentário